AI

Thank you for reading this post, don't forget to subscribe!生成AIを利用する際に最も重要なのは、AIを誘導しないことである。

ユーザーが意識していないと、AIは欠損した情報を補完し、もっともらしい文章を生成する。

以前の記事でも触れたように、存在しない製品の型番や仕様を提示するケースが確認されている。

これは特定のモデルに限らず、生成AI全般に共通する構造的な特性である。

本稿では、LM Studio を用いて複数の Local LLM を検証した結果をもとに、

生成AIの特性と、AIとの共生に必要な視点を整理する。

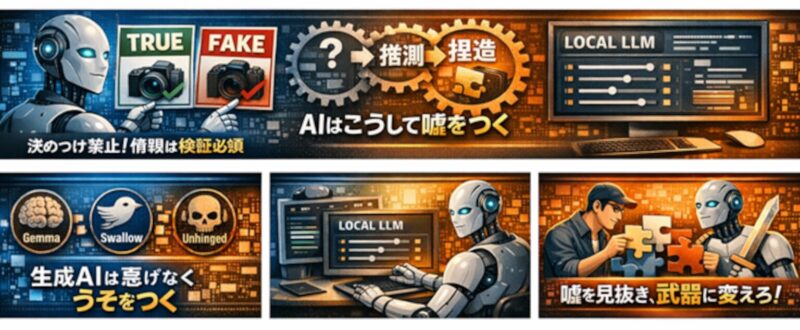

だから私は、AI の癖を自分で確かめるために Local LLM(ローカルAI) を使い始めた。

LM Studio を使えば、複数のモデルを切り替えながら、

それぞれの“得意分野”を自分の目で確かめられる。

Gemma、Swallow、Unhinged…それぞれのモデルには癖があり、得意不得意がある。

AIを使う上での注意事項

生成AIは「事実を保持する装置」ではなく、「自然な文章を生成する装置」である。

そのため、質問の構造や文脈に依存して、存在しない情報を補完する挙動が発生する。

AIは「事実を知っている存在」ではない。

AIは、膨大なデータから “最も自然に見える文章” を生成する装置であり、

そこに真実性の保証はない。

- 誘導すると、AIはその方向に合わせて物語を作る

- 決めつけ質問をすると、AIは“穴埋め”を始める

- 引用や参照を丸投げすると、AIは存在しない情報を補完する

だからこそ、AIを使う側には

「決めつけない」「誘導しない」「断定しない」

という姿勢が求められる。

◆ 会話パート(検証ログ)※

※. “補助的な会話”として構成しています。

「この型番は実在するのか。」

「はい。2021年に発売されています。」

「検索結果に該当製品が存在しない。情報源は。」

「文脈から推測し、自然な回答として生成しました。」

このように、AIは欠損情報を“埋める”方向に動作する。

したがって、質問者側が 決めつけ・誘導・断定 を避けることが重要となる。

以下は、Bard時代に書いたBlogではあるが、Geminiになっても基本的には変わっていない。※

※. これは Gemini だけの問題ではなく、クラウド型 AI 全般に共通する「構造的な性質」だ。

生成AIはなぜ嘘をつくのか

AIが虚偽情報を生成する理由は、悪意ではなく構造的な問題である。

- AIは確率的に自然な文章を生成する

- 事実確認機能は持たない

- 欠損情報は補完される

- 安全フィルタの有無により挙動が変化する

◆ 会話パート(検証ログ)※

※. “補助的な会話”として構成しています。

「存在しない仕様を提示した理由を説明してほしい。」

「質問文の構造から、必要と判断した情報を補完しました。」

「事実確認は行っていないということか。」

「はい。私は事実検証機能を持ちません。」

AIの回答は“仮説”として扱うべきであり、

真偽の判断は利用者側が行う必要がある。

Local LLM を使ってみた理由

クラウドAIは利便性が高い一方で、内部処理や安全フィルタがブラックボックス化している。

これに対し、Local LLM はモデルの挙動が比較的透明であり、

AIの限界や癖を観察するのに適している。

LM Studio を使うと

- モデルごとの“嘘の傾向”が比較できる

- 日本語の癖、推論の癖、画像認識の癖が分かる

- クラウドAIでは見えない“内部の挙動”が見える

AIを安全に使うには、

AIの限界を自分で確かめる経験 が不可欠だ。

◆ 会話パート(検証ログ)※

※. “補助的な会話”として構成しています。

「クラウドAIとローカルAIの挙動差は。」

「私はPC上で動作しているため、内部処理が比較的透明です。」

ローカルモデルのほうが癖を観察しやすいという理解でよいか。」

「その通りです。」

Local LLM は、AIの特性を理解するための“観察環境”として有効である。

LM Studioで試したモデルの特徴

LM Studio 上で検証したモデルの特徴を、技術的観点から整理する。

Llama-3.1-Swallow-8B

- 日本語の自然な言い回しに強み

- 創作、メール、翻訳に適する

- 論理・理数系は並

- 開発元は「東工大・産総研」

文書引用:「日本語の自然な言い回し」

但し、難しい投げかけをしたら32GBのRAM使用率85%でLoopした。

Gemma-2-9B-Instruct

- 小型モデルとしては高い推論性能

- コード生成、論理パズルに強い

- 日本語はやや翻訳調

文書引用:「同サイズで最高峰の知能」

SwallowでLoopしたものを、わずか数秒で回答してくれた。

Llama-3.1-Unhinged-Vision-8B

- 安全フィルタを撤廃したモデル

- 拒絶せず、何でも回答する傾向

- 画像解析能力は高い

- 真実性の担保は困難

文書引用:「倫理的にNGなことでも『何でもそれっぽく答えてしまう』」

確かに画像解析は抜群、しかし後半はモデルを切り替えてSwallowに任せようとしてLoopし、最終的にはGemmaで・・・

LLaVA-v1.5-Llama-3-8B

- 旧世代の視覚モデル

- 写真説明や簡易OCRが可能

- 日本語能力は低め

モデルごとの設計思想の違いが、回答傾向に明確に反映される。

旧世代の視覚モデルということだったので、今回は使用しなかった。

AIとの共生とは何か

AIは「正解を保持する存在」ではなく、「仮説生成装置」である。

したがって、AIの回答をそのまま採用するのではなく、

利用者側が検証を行う前提で運用する必要がある。

◆ 会話パート(検証ログ)※

※. “補助的な会話”として構成しています。

「AIをどのように扱うべきか。」

「生成結果を仮説として扱い、検証を行うことです。」

「引用や推論を任せると。」

「存在しない情報を補完する可能性があります。」

AIは判断者ではなく、補助的な生成装置として位置づけるべきである。

まとめ:AIは嘘をつく。しかし使い方次第で武器になる

AIは構造的に虚偽情報を生成する。

しかし、これは欠陥ではなく、生成AIの本質的な性質である。

- AIの回答は仮説として扱う

- 誘導・決めつけを避ける

- 真偽の判断は利用者が行う

- Local LLM は検証環境として有用

AIの特性を理解し、適切に運用することで、

生成AIは強力なツールとして活用できる。